大语言模型比较---以Fracman为例

摘要

本文介绍了Open-WebUI的升级过程,涉及下载最新代码、停止和删除旧容器、以及使用新映像创建新容器。同时,列出了当前安装的多个大语言模型,包括它们的大小和适用情况。在模型比较部分,通过特定测试任务“Using fracman to understand wedge failures for open pit slope design”对各模型进行了评估,结果显示Llama3和Llama3:70b-instruct模型在提供详细和合理回答方面表现较好,但Command-R-Plus模型虽准确但运行时间较长,而其他模型在识别特定术语或提供有用信息方面存在不足。

正文

1. 引言

Open-WebUI【Open-webui---构建基于本地知识库的大语言模型框架】是本地最主要的LLM框架,由于docker下的代码升级与Windows程序的升级方式不同,因此记录下这个过程,便于以后再次升级使用。

2. 升级Open-WebUI

docker pull ghcr.io/open-webui/open-webui:maindocker stop open-webuidocker rm open-webui

(3) 使用更新后的映像创建新容器,使用与创建容器时相同的 docker run 命令,确保所有配置保持不变。

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main上述过程会将 Open WebUI 容器更新为最新版本,同时保留存储在 Docker 卷中的数据。

3. 目前安装的模型

目前已经安装了以下模型:

(1) command-r:latest (20 GB)

(2) command-r-plus:latest (59 GB)

(3) dolphin-llama3:latest (4.7 GB)

(4) gemma:latest (5.0 GB)

(5) llama2:latest (3.8 GB)

(6) llama3:70b-instruct (39 GB)

(7) llama3:latest (4.7 GB)

(8) mistral:latest (4.1 GB)

(9) mxbai-embed-large:latest (669 MB)

(10) nomic-embed-text:latest (274 MB)

(11) wizardlm2:latest (4.1 GB)

其中(2)和(6)的模型尺寸太大,目前的机器配置不能顺利使用这两个模型【2024年第16周 | 顺利运行大语言模型所需的内存】;(9)和(10)用于词嵌入。

4. 模型比较

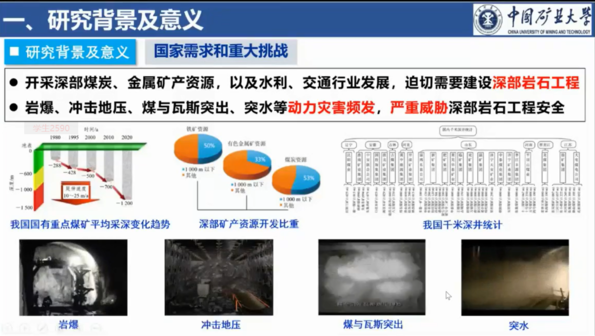

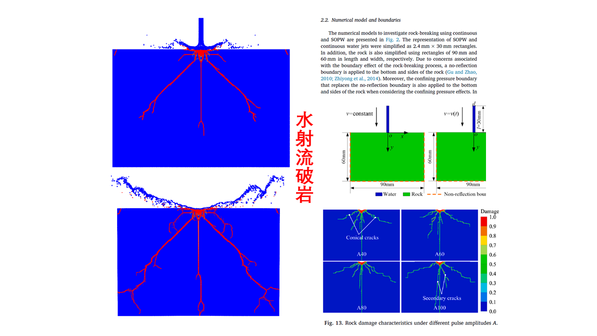

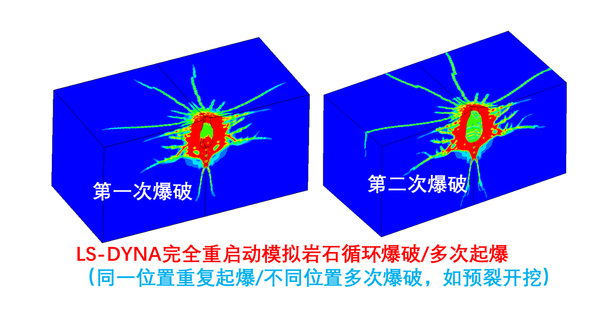

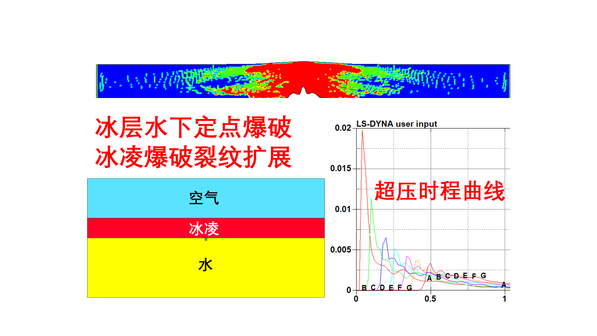

语义搜索 | 使用Fracman进行岩石楔分析 Fracman读取FLAC3D生成的离散断裂网络(DFN)模型 Fracman的岩土模块---主要功能和参考文献 FLAC3D导入Fracman生成的离散断裂网络(DFN)模型 露天矿边坡稳定性的离散断裂网络(DFN)分析