PINN:物理信息神经网络的最新研究进展

文一:

基于物理学的高速流神经网络

摘要:

在这项工作中,我们研究了使用物理信息神经网络(PINN)来近似建立高速气动流模型的欧拉方程的可能性。特别地,我们解决了一维和二维域中的正问题和反问题。对于正演问题,我们利用欧拉方程和初始/边界条件来公式化损失函数,并用光滑解和具有接触不连续性的解以及二维斜激波问题来求解一维欧拉方程。我们证明,我们可以捕获只有几个分散点随机聚集在不连续性周围的解。对于反问题,通过模拟高速空气动力学中传统使用的纹影摄影实验技术,我们使用密度梯度ρ(x,t)、指定点x=x*处的压力p(x*,t)的数据以及守恒定律来推断所有感兴趣的状态(密度、速度和压力场)。我们给出了具有光滑解的问题和具有PINN的黎曼问题(Sod和Lax问题)的说明性基准示例,证明了所有推断的状态与参考解都很好地一致。此外,我们还表明,点x*的位置选择在学习过程中起着重要作用。特别是,对于具有光滑解的问题,我们可以从计算域中随机选择点x*的位置,而对于Sod或Lax问题,我们必须从初始不连续点和最终时间的冲击位置之间的域中选择点x**的位置。我们还通过将上述数据与特征形式的欧拉方程相结合来求解反问题,表明使用特征形式的Euler方程所获得的结果比使用保守形式的Eur方程所得到的结果要好。此外,我们还考虑了另一类反问题,具体地说,我们利用给定的密度、速度和压力数据,利用PINN来学习参数化二维斜波问题状态方程中参数γ的值,并准确地识别了参数γ。总之,我们的结果表明,在目前的形式中,守恒定律是强加在随机点上的,对于正演问题,PINN不如传统的数值方法准确,但对于甚至无法用标准技术求解的反问题,它们更为优越。

图:欧拉方程的PINN示意图。左边的NN是不知情的,右边的NN是由守恒定律诱导的知情的。这两个神经网络共享超参数,并且它们都对损失函数有贡献。

图:示例3的反问题,即反Sod问题的训练点的分布:左上角:密度梯度的均匀分布数据;右上角:F的均匀分布点,即欧拉方程;左下:密度梯度的随机分布数据;右下角:F的随机分布点,即欧拉方程。

图:示例1的前向问题:上:随机分布的训练和残差点的分布(左)和聚类的训练和残留点(右)。蓝色星点是域内对应于与欧拉方程相关联的损失的残差点,而红十字点是对应于与IC/BC相关联的损耗的训练点。Lower:通过使用损失函数(3.1)获得的x−t域中密度的PINN解,该损失函数具有随机分布的训练和残差点(左)以及聚类的训练和残留点(右)。

文二:

物理信息神经网络中的对抗不确定性量化

摘要:

我们提出了一个深度学习框架,用于使用基于物理的神经网络来量化和传播非线性微分方程控制系统中的不确定性。具体来说,我们使用潜变量模型来构建系统状态的概率表示,并提出了一种对抗性推理程序来对它们进行数据训练,同时约束它们的预测以满足由偏微分方程表示的给定物理定律。这种基于物理的约束提供了一种正则化机制,用于有效地将深度生成模型训练为物理系统的替代品,在物理系统中,数据获取成本很高,并且训练数据集通常很小。这提供了一个灵活的框架,用于表征物理系统的输出中由于其输入的随机性或观测中的噪声而产生的不确定性,完全绕过了重复采样昂贵的实验或数值模拟器的需要。我们通过一系列测试证明了我们方法的有效性,这些测试涉及非线性守恒定律中的不确定性传播,以及直接从噪声数据中发现流经多孔介质的本构定律。

图:未知状态相关扩散系数 K (u (x1,x2))的预测。(a)用 van Genuchten 模型[58]从地下多相输运(STOMP)代码[57]获得的参考解(见方程(24))。(b)对 u (x)的无噪音数据训练的生成模型 pθ,γ (k | x,z)的预测平均值。(c)绝对逐点预测误差。

图:具有无噪声数据的Burgers方程:顶部:pθ(u|x,t,z)的平均值,以及噪声训练数据的位置{(xi,ti),ui},i=1。中间:t=0.25、t=0.5和t=0.75时的预测和预测不确定度。底部:pθ(u|x,t,z)的方差。

文三:

B-PINNs:用于含噪声数据的正向和反向PDE问题的贝叶斯物理信息神经网络

摘要:

我们提出了一种贝叶斯物理知情神经网络(B-PINN)来解决由偏微分方程(PDE)和噪声数据描述的正逆非线性问题。在该贝叶斯框架中,贝叶斯神经网络(BNN)与偏微分方程的PINN相结合用作先验,而哈密顿蒙特卡罗(HMC)或变分推理(VI)可以用作后验的估计器。B-PINN利用物理定律和散射噪声测量来提供预测,并在贝叶斯框架中量化噪声数据产生的任意不确定性。与PINN相比,除了不确定性量化之外,B-PINN由于其避免过拟合的能力,在具有大噪声的场景中获得了更准确的预测。我们对B-PINN后验估计的两种不同方法(即HMC或VI)以及用于量化深度神经网络中不确定性的dropout进行了系统比较。我们的实验表明,HMC比具有平均场高斯近似的VI更适合用于B-PINN的后验估计,而PINN中使用的dropout很难提供具有合理不确定性的准确预测。最后,我们用截断的Karhunen-Loève(KL)展开与HMC或深度归一化流(DNF)模型相结合作为后验估计来代替先前的BNN。KL与BNN一样准确,速度更快,但与基于BNN的框架不同,该框架无法轻松扩展到高维问题。

图:贝叶斯物理信息神经网络(B-PINN)示意图

图:协方差函数

图:函数逼近及不同方法的比较

图:二维Allen-Cahn方程-正演问题:预测误差和标准差

文四:

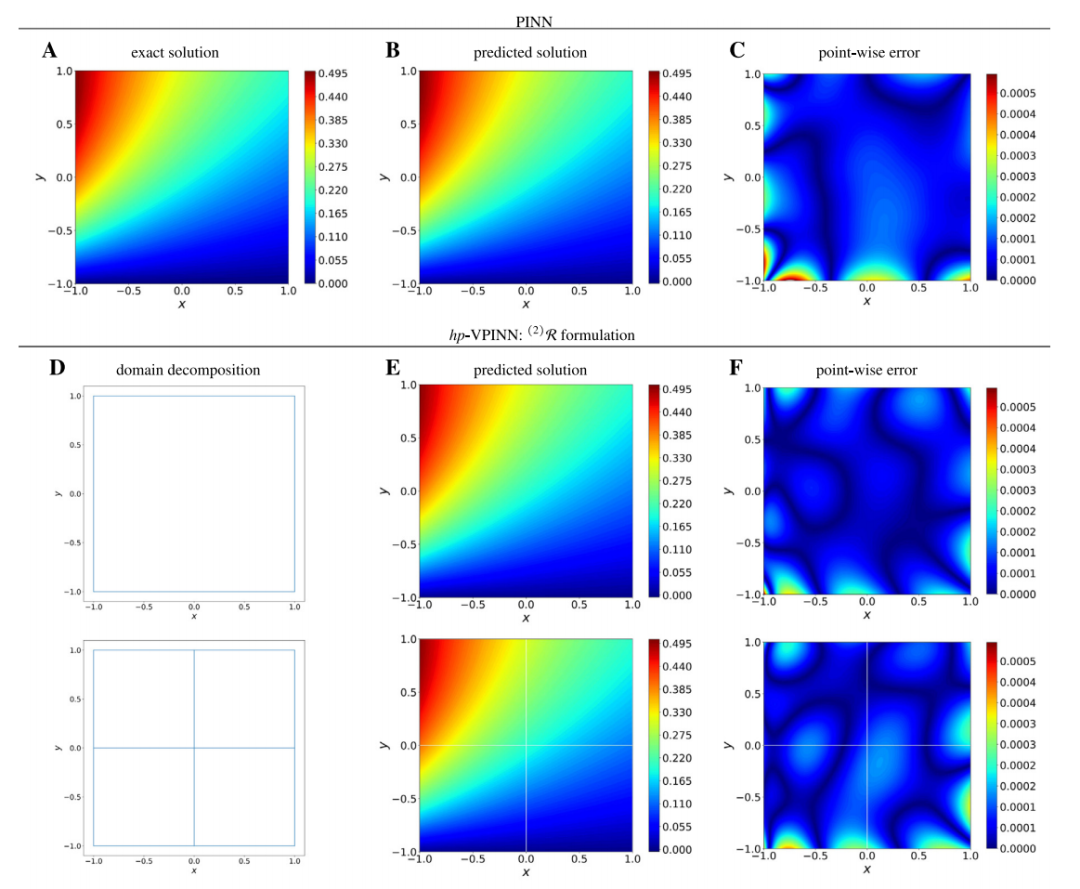

Hp-VPINNs: 基于区域分解的变分物理信息神经网络

摘要:

基于浅层和深层神经网络的非线性逼近以及通过域分解和投影到高阶多项式空间上的hp精化,我们建立了hp变分物理知情神经网络(hp VPINNs)的通用框架。试验空间是神经网络的空间,在整个计算域上全局定义,而测试空间包含分段多项式。具体来说,在本研究中,hp精化对应于具有局部学习算法的全局近似,该算法可以有效地定位网络参数优化。我们为函数逼近和求解微分方程的几个数值例子展示了hp-VPINNs在精度和训练成本方面的优势。

图:二维齐次泊松方程。

图:L 形区域上的二维齐次泊松方程。

文五:

自适应激活函数加速深度和物理信息神经网络的收敛

摘要:

我们在深度和物理知情神经网络(PINN)中使用自适应激活函数进行回归,以近似光滑和不连续函数以及线性和非线性偏微分方程的解。特别地,我们求解了具有光滑解的非线性Klein-Gordon方程,可以允许高梯度解的非线性Burgers方程,以及Helmholtz方程。我们在激活函数中引入了一个可扩展的超参数,当它动态改变优化过程中涉及的损失函数的拓扑时,可以对其进行优化,以实现网络的最佳性能。自适应激活函数比传统激活函数(固定激活)具有更好的学习能力,因为它大大提高了收敛速度,尤其是在早期训练时,以及求解精度。为了更好地理解学习过程,我们在频域中绘制了神经网络解决方案,以检查网络如何连续捕获解决方案中存在的不同频带。我们既考虑了获得近似解的正问题,也考虑了识别控制方程中涉及的参数的反问题。我们的仿真结果表明,所提出的方法是一种非常简单有效的方法,可以提高非线性函数的神经网络逼近以及偏微分方程解的效率、鲁棒性和准确性,特别是对于正演问题。我们从理论上证明了在所提出的方法中,梯度下降算法不受次优临界点或局部极小值的吸引。此外,使用CIFAR-10、CIFAR-100、SVHN、MNIST、KMNIST、Fashion MNIST和Semion数据集,无论是否增加数据,所提出的自适应激活函数都可以加速标准深度学习基准中损失值的最小化过程。

图:Burgers方程:(上排)初始和最终的tanh(左)和sin(右)激活函数,(中排)tanh(左侧)和sin(右侧)激活平面显示了激活函数随a的变化,(下排)显示了相应的激活面。

图:等高线图(顶部)显示了使用自适应激活函数的亥姆霍兹方程的解。中间行和底部行分别在3600次迭代后使用固定(中间)和变量a,n=10(底部)的“tanh”激活函数将PINN解与精确解进行比较。

图:Sine-Gordon方程:干净数据以及使用Nu=500的有噪声数据的损失函数(左)和na的变化(右)。