本期给大家推荐李彦夫教授的故障预测与健康管理的类ChatGPT大模型:综述和发展路线图(上)。近年来,基于人工智能(Artificial Intelligence, AI)的故障预测与健康管理(Prognostics and Health Management, PHM)方法取得了显著成就。ChatGPT和DALLE-E等大模型(Large-Scale Foundation Models, LSF-Models)的出现,标志着AI从AI-1.0进入了AI-2.0的新时代,深度模型从单模态、单任务、有限数据的研究范式迅速演变为多模态、多任务、海量数据和超大模型的范式。然而,PHM领域对于如何应对这一重大变革尚未达成共识。因此,本文阐述了LSF-Models的关键组件和最新发展,系统地回答了如何构建适用于PHM任务的LSF-Models,并概述了这一研究范式面临的挑战和未来发展路线图。

论文链接:通过点击本文左下角的阅读原文进行在线阅读及下载。

论文基本信息

论文题目:

ChatGPT-like large-scale foundation models for prognostics and health management: A survey and roadmaps

论文期刊:Reliability Engineering and System Safety

论文日期:2024年

论文链接:https://doi.org/10.1016/j.ress.2023.109850

作者:Yan-Fu Li (a, b), Huan Wang (a, b), Muxia Sun (a, b)

机构:

a: Department of Industrial Engineering, Tsinghua University, Beijing 100084, China;

b: Institute for Quality and Reliability, Tsinghua University, Beijing 100084, China

通讯作者邮箱: huan-wan21@mails.tsinghua.edu.cn

作者简介:

李彦夫,清华大学质量与可靠性研究院院长、清华大学工业工程系长聘教授。2011-2016年任教于法国巴黎中央理工与高等电力学院。长期致力于系统可靠性、预测性维护(PdM)理论与方法的研究。代表性论文发表在《Production and Operations Management》、《INFORMS Journal on Computing》、《IEEE Transactions》系列、《IISE Transactions》等国际著名期刊,其中ESI高被引6篇,2019-2023年连续入选爱斯维尔中国高被引学者榜单,2020-2022连续入选美国斯坦福大学发布的全球前2%顶尖科学家榜单。出版专著2部,编著教材2部,授权发明专利11项。主持国家自然科学基金重点项目、国家重点研发计划课题以及市场监管总局委托项目。与华为、南方电网等头部企业长期合作,多项研究成果企业应用转化。获得中国运筹学会应用奖、省部级科技进步二等奖1项,以及多项国际国内学会论文奖项。服务质量强国战略,开展质量政策研究,多项资政报告成果被市场监管总局、全国人大财经委等部门采纳。担任可靠性旗舰期刊《Reliability Engineering & Systems Safety》和《IEEE Transactions on Reliability》副主编、中国系统工程学会系统可靠性专委会副主任委员、中国质量奖评审专家。

目录

1 摘要

2 引言

3 大模型的关键组成部分

3.1 基于Transformer的特征提取

3.2 基于自监督学习的特征表示

3.3 多模态融合

4 大模型的进展

4.1 NLP中的大模型

4.2 CV中的大模型

4.3 研究趋势与未来方向

5.1 用于PHM的大规模数据集

5.1.1 研究现状

5.1.2 解决方案

5.2 用于PHM的Transformer

5.2.1 研究现状

5.2.2 解决方案

5.3 用于PHM的自监督学习

5.3.1 研究现状

5.3.2 解决方案

5.4 用于PHM的多模态融合

5.4.1 研究现状

5.4.2 解决方案

(以上标记章节为本文内容)

6 挑战与未来路线

7 总结

1 摘要

故障预测与健康管理(Prognostics and Health Management, PHM)技术在工业生产和维护中至关重要,它能够识别和预测潜在的设备失效及损坏,从而实施主动维护措施,提高设备可靠性并降低生产成本。近年来,基于人工智能(Artificial Intelligence, AI)的PHM方法取得了显著成就,并广泛应用于铁路、能源、航空等多个行业的状态监测、故障预测和健康管理。ChatGPT和DALLE-E等大模型(Large-Scale Foundation Models, LSF-Models)的出现,标志着AI从AI-1.0进入了AI-2.0的新时代,深度模型从单模态、单任务、有限数据的研究范式迅速演变为多模态、多任务、海量数据和超大模型的范式。ChatGPT因其出色的自然语言理解能力成为这一研究范式的标志性成果,为通用AI带来了希望。然而,PHM领域对于如何应对这一重大变革尚未达成共识,需要系统的综述和路线图来阐明未来的发展方向。因此,本文阐述了LSF-Models的关键组件和最新发展,系统地回答了如何构建适用于PHM任务的LSF-Models,并概述了这一研究范式面临的挑战和未来发展路线图。

关键词:故障预测与健康管理;故障诊断;大模型;表征学习

2 引言

故障预测与健康管理(Prognostics and Health Management, PHM)是确保工业设备安全可靠运行的关键技术[1, 2]。通过全面监测和管理设备,PHM可降低设备失效概率,减少生产停机时间,从而提高设备可靠性和生产效率,为企业创造显著经济效益[3, 4]。随着工业设备日益精密复杂,运行监测数据量不断增长,工业数据分析、设备状态监测和健康管理的自动化成为必然需求[5]。这种自动化能够显著降低工业资产的维护成本,提高设备状态识别和故障预测的效率与准确性,增强设备运行的可靠性和安全性。

近年来,随着机器学习(Machine Learning, ML)和深度学习(Deep learning, DL)技术的进步,PHM发展迅速[6, 7],实现了工业设备状态的自动监测和故障预测,极大地提升了工业资产维护的智能化水平。自20世纪初以来,ML技术在实现PHM的智能识别和决策方面发挥了关键作用[8, 9]。基于ML的PHM模型主要包括特征工程和ML模型两个核心部分。特征工程利用统计分析和信号分析技术[10, 11]从工业监测数据中提取与健康相关的特征信息,ML模型则使用支持向量机(Support Vector Machines, SVM)[8, 9]、K-近邻(K-nearest Neighbor,KNN)[12, 13]等各种预测和识别模型来实现智能决策。这一研究范式使PHM初步实现自动化,减少了工业设备维护中的人力需求。然而,仍需手动进行特征工程限制了PHM处理大规模数据的能力。ML模型有限的学习能力使其难以适应大数据时代的挑战。

自2012年以来,DL技术[14, 15]凭借其强大的数据分析、特征提取和智能决策能力,颠覆了各个研究领域的范式。DL通过构建多层神经网络结构实现对复杂数据的自动特征提取和模式识别,能够自动处理高维、非线性和大量数据,并具有自适应和泛化能力。因此,DL已成为PHM的主流工具[7, 16, 17],不断提高工业资产维护的自动化和智能化水平。针对不同的PHM应用和任务,人们提出了各种深度网络模型,如自编码器[18, 19]、卷积神经网络(Convolutional Neural Networks, CNNs)[20-24]和循环神经网络(Recurrent Neural Networks, RNNs)[25, 26]等。自编码器通过数据压缩或重构实现无监督表征学习,在数据降噪、降维和异常检测等任务中表现出色[27]。CNN基于卷积理论,通过权值共享和分层学习实现高效的时空特征提取,适用于工业设备的健康监测、故障预测与诊断以及剩余使用寿命(Remaining Useful Life, RUL)预测[28]。RNN擅长编码长距离时序特征,非常适合分析和处理各种时序信号[29],因此在各种工业PHM应用中得到广泛使用。DL技术通过构建端到端的智能决策模型,显著减少了工业PHM应用中的人力需求[30]。然而,现有的DL模型在多任务、泛化性和认知能力方面仍存在局限性。因此,如何突破这些限制,实现具有高泛化和认知能力的综合多任务智能模型是一个亟待解决的问题。

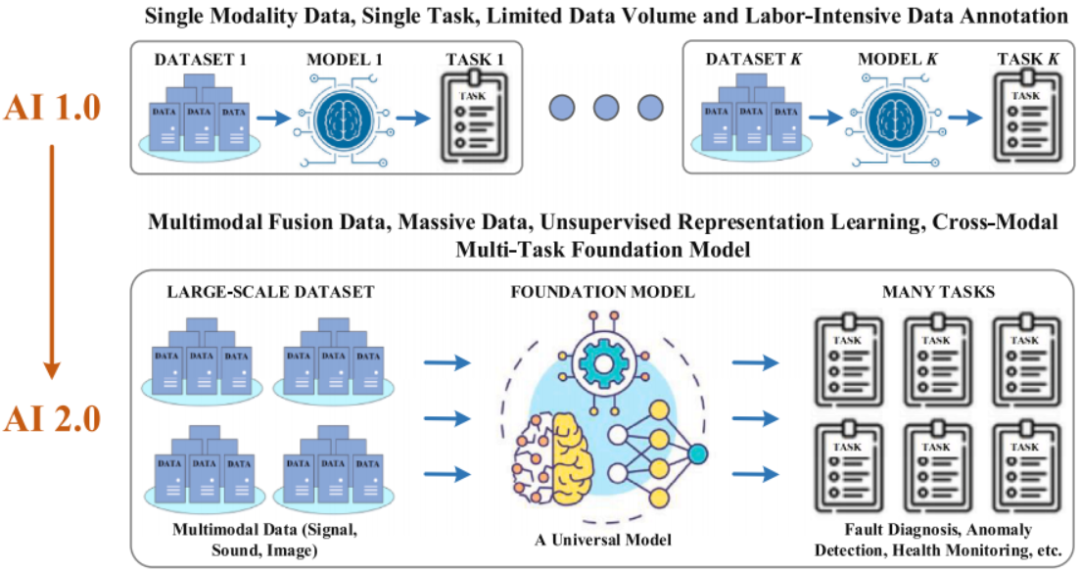

在过去两年中,GPT-3[33, 34]和ChatGPT[35, 36]等大模型(Large-Scale Foundation Models, LSF-Models)[31, 32]通过流畅的文本对话展示出高度智能的自然语言理解能力。大规模多模态文本和图像理解模型,如GPT-4[37]、DALL-E-2[38]和Segment Anything模型(Segment Anything Model, SAM)[39],进一步展示了这一研究范式在多模态对话、图像生成和分割方面的非凡成就。基于人工智能(Artificial Intelligence, AI)的深度模型已从单模态、单任务、有限数据的研究范式(AI-1.0)迅速发展为多模态、多任务、海量数据和超大模型的研究范式(AI-2.0)。图1清楚地展示了这两种研究范式之间的差异。AI-2.0的核心是具有跨域知识的LSF-Model,它能够理解数据的一般概念,并在无需额外训练的情况下对未见过的数据实现零样本泛化[39]。该模型的实现主要基于以下三个关键部分:强大的特征提取模型[40, 41]、无监督表征学习算法[42]和多模态融合(Multi-Modal Fusion, MMF)算法[43, 44]。此外,大量未标记或标记的多模态数据是这一发展的先决条件。然而,如何在PHM中构建具有跨域知识的LSF-Model仍是未知的,对于如何开发适用于PHM领域的特征提取、表征学习和MMF算法,也缺乏足够的研究和分析。此外,PHM领域应如何应对AI领域的这一巨大变化尚无定论,且缺乏系统的文献综述以及未来研究方向的路线图。为填补这一空白,本文首先介绍了LSF-Models的关键组成部分和前沿进展,然后系统地回答了如何构建适用于PHM领域的有效的LSF-Models。我们还详细阐述了这一研究范式将面临的挑战和未来发展路线图。我们主要使用学术数据库(如 Web of Science 和Google Scholar)搜索相关研究工作。为确保综述论文的前沿性和新颖性,引用的大多数论文都在过去五年内。文献搜索过程中使用的关键词包括PHM, large-scale model, Transformer, self-supervised learning以及其他与大模型和PHM相关的关键词。

图1 从AI-1.0到AI-2.0,DL的研究范式发生的巨大变化

具体而言,本文的主要贡献如下:

(1)对LSF-Models的三个关键组成部分及其各自的研究进展进行了全面综述。

(2)结合PHM的实际情况,系统分析并回答了如何构建适用于工业PHM应用的有效的LSF-Models。

(3)讨论了PHM中LSF-Model研究的路线图,并详细分析了这一研究范式面临的挑战和解决方案。

(4)尽我们所知,这是第一篇讨论LSF-Models在PHM领域应用和研究的综述论文,有望为该领域的研究提供有价值的指导。

本文其余部分组织如下:第2节重点介绍LSF-Models的关键组成部分;第3节回顾LSF-Models的研究进展;第4节系统地回答如何在PHM中实现LSF-Models;第5节全面讨论PHM中LSF-Model研究面临的挑战及其未来路线图;第6节给出结论。

3 大模型的关键组成部分

LSF-Models是一类由数十亿参数组成的大规模DL模型[32]。这些模型在大量数据上进行训练,以捕捉数据的复杂关系和一般概念,从而具备跨任务和跨域的零样本泛化能力。LSF-Models的发展得益于多种技术的进步,包括计算硬件的提升、大数据的可用性、表征学习的发展、模型架构的改进以及MMF算法的进步。计算硬件的提升和大数据的可用性是LSF-Models的基本条件[45],这主要得益于近年来计算硬件和互联网的发展,为实现LSF-Models提供了硬件基础和数据基础。此外,算法和神经网络的发展在LSF-Models的开发中也发挥了不可或缺的作用。例如,Transformer架构的提出为大模型提供了强大的特征提取能力[41],自监督学习(Self-supervised Learning, SSL)促进了大模型强大的无监督特征表征能力的发展[42],MMF算法使大模型能够跨模态交互。此外,其他算法(监督学习、强化学习)和优化算法对于改进LSF-Models也至关重要。在构建模型时,需要根据任务和数据选择合适的算法。

3.1 基于Transformer的特征提取

Transformer[46]是一种基于自注意力机制的强大网络模型,最初应用于序列建模和自然语言处理(Natural Language Processing, NLP)[47]等领域。图2展示了Transformer的基本架构,它是一种典型的编码器-解码器架构,编码器和解码器由多个Transformer块组成。编码器将输入序列编码为隐藏向量表示,解码器则合成隐藏向量的上下文信息以生成序列信息。每个Transformer块包含多头注意力(Multi-head Attention, MHA)机制、前馈神经网络(Feed-Forward Neural Network, FFNN)、残差连接[48]和层归一化[49]。

图2 Transformer、自注意力模型和多头注意力模型的架构细节(图来自[21, 46])

Transformer的开创性架构设计使其能够获得出色的特征提取性能,从而吸引学者不断改进和优化其关键组成部分。注意力机制是Transformer的核心,其主要改进方向包括:(1)稀疏注意力[50]:致力于在注意力机制中引入稀疏性偏差;(2)线性化注意力[51]:专注于优化自注意力的特征交互以实现线性复杂度;(3)优化MHA机制[52, 53]:重点是使不同的注意力头能够充分捕获不同的有价值特征;(4)注意力机制的替代方案[54, 55]:致力于寻找新的方案以实现更快、更高效的全局信息交互机制。此外,学者们在改进和优化Transformer的激活函数[56, 57]和FFNN[58]方面也做了大量工作。除了对Transformer内部核心组成部分的研究,优化Transformer的整体架构也是一个研究重点[59]。

随着视觉Transformer(Vision Transformer, ViT)[60]的提出,Transformer逐渐被引入图像处理[41]、视频分析[61]等相关领域,并在这些领域表现出色。为此,各种ViT架构如雨后春笋般涌现[40]。例如,Liu等[62]提出了一种基于移位窗口的新型分层Transformer架构,可广泛适用于各种视觉应用。Transformer模型已发展成为一个超大系统,并出现了大量的研究工作,详细综述和分析可参考相关综述论文[41]。

SSL[42]是一种无监督学习,通过从未标记数据中生成监督信号来发现有效的特征表示。与需要大量标记数据的传统监督学习不同,SSL利用未标记数据的丰富信息,减少对人工标记数据的依赖。通常,SSL通过设计一个前置任务,使模型在解决该任务的过程中获取有价值的表示。SSL的流程图如图3所示。SSL在计算机视觉(CV)和NLP中有许多经典算法,主要包括以下方法:

图3 以PHM应用为例的SSL算法流程图

掩码语言建模(Masked Language Modeling, MLM):该方法的基本概念是在输入序列中随机掩码特定的单词或字符,然后提示模型预测被掩码的标记[63, 64]。MLM是当前NLP领域最流行的预训练方法之一。除MLM外,还有一些相关的SSL方法,如下一句预测[65, 66]和回译[67]等,这些技术可用于预训练NLP应用,以增强模型的泛化能力和性能。

自回归模型:该方法常用于NLP领域的预训练,它根据给定的上下文预测下一个单词[68, 69]。例如,GPT[68]就是一种典型的基于自回归的方法,通过这种方式,GPT能够学习丰富的上下文相关信息,并在NLP应用中取得了显著成功。XLNet[69]引入了广义自回归预训练技术,突破了基于Transformer的双向编码器(Bidirectional Encoder Representations from Transformers, BERT)的限制,实现了更好的上下文依赖学习。

自编码器:自编码器是一种经典的表征学习算法,由编码器和解码器组成[70, 71]。编码器将输入数据映射到潜在空间,解码器从潜在空间重构输入数据。这些算法通过最小化重构误差从图像中学习有价值的特征表示。Lin等[71]提出了一种掩码自编码器预训练策略来处理文本和视觉数据,实现了多模态特征表示。

对比学习:该方法旨在将相似样本映射到相近的空间,将不相似样本映射到较远的空间[72]。这有助于模型学习数据之间的差异和变化,从而提高模型的泛化能力和性能[73]。一般来说,对比学习方法包括两个阶段:构建对比对和训练模型。在对比对构建阶段,通常使用随机数据增强等技术生成相似和不相似的样本对。在随后的模型训练阶段,通常采用对比损失函数来最小化相似样本对之间的距离,并最大化不相似样本对之间的距离。

基于图像增强的自监督方法:这些方法主要包括旋转预测、图像着色、图像拼图、图像修复和图像超分辨率等。这些方法作为前置任务,利用了图像数据的固有特性。旋转预测[74]通过旋转输入图像并预测旋转角度,使模型学习图像的旋转不变性;图像着色[75]通过为灰度图像添加合适的颜色,获取有价值的上下文信息,增强模型对数据的理解;图像拼图[76]将图像分割成块并重新组装,让模型学习不同图像部分之间的关系,提高其捕获图像特征的能力;图像修复[77]旨在掩盖或去除图像中的特定区域,教导模型推断和填充缺失部分,从而增强其理解图像特征的能力;图像超分辨率[78]专注于从低分辨率数据生成高分辨率数据,使模型能够更有效地学习详细的图像信息。

SSL的优势在于能够利用数据的固有特性,使模型从大量未标记数据中学习通用和高质量的数据特征以及潜在关系,这有助于模型更好地理解数据的本质和规律,显著降低了人工标注数据的成本。这一特性也使得SSL适用于大规模数据集,在LSF-Models的研究中发挥着至关重要的作用。因此,出现了大量与SSL相关的研究工作,详细综述和分析可参考相关综述论文[42]。

3.3 多模态融合

MMF[79, 80]是一种整合来自不同模态(如文本、图像、音频和视频)信息的技术,旨在提高模型性能和泛化能力。MMF旨在通过利用多个数据源之间的互补信息提取更全面的特征表示,从而提高模型在各种应用中的性能。到目前为止,MMF方法包括以下几种:

早期融合:在输入层整合来自不同模态的信息,以获得全面的多模态表示,随后将其输入到深度神经网络中进行训练和预测。

晚期融合:在各自的神经网络中独立提取和处理来自不同模态的特征,并在输出层融合这些特征以获得最终预测结果。

注意力融合[81, 82]:利用注意力机制对来自不同模态的信息进行加权融合,增强重要信息的权重,以获得更准确的多模态表示和预测结果。

异构融合[83, 84]:在异构图上结合来自不同模态的信息,考虑不同模态的特征和相互关系,从而获得更准确的多模态表示和预测结果。

基于提示的方法[85, 86]:将自然语言提示引入模型以提高其性能。在MMF任务中,提示可以引导模型生成准确的跨模态预测结果。

在LSF-Models研究中,MMF算法通常需要具备以下特性:多源,能够同时融合来自多个源的数据;多级,可以在不同特征级别融合多模态数据,提高数据处理和分析的准确性和效率;多样性,能够处理来自多种模态(如图像、语音、文本等)的数据。可以看出,对MMF的研究使模型能够从多个角度理解现实世界的各种一般概念。就像人类拥有视觉、听觉、触觉等感觉器官一样,通用AI模型无疑将具有强大的多模态信息感知能力。

4 大模型的进展

在前一节中,我们讨论了构建LSF-Models所必需的几个关键组成部分。本节将概述LSF-Models在NLP和CV领域的进展,以展示这些领域的最新发展趋势和方向。

4.1 NLP中的大模型

由于互联网技术的进步,获取超大规模文本数据变得越来越方便,这使得LSF-Models在NLP领域取得了显著进展[87, 88]。当前的大语言模型(Large-scale Language Models, LSLMs)能够高效、准确地完成各种NLP应用[89]。目前,NLP领域已经出现了大量的LSF-Models,主要模型如下:

BERT系列模型:BERT[90]是一种基于预训练双向Transformer架构的语言模型。BERT通过预训练从大量未标记文本中获取通用语言表示,其预训练任务包括MLM和下一句预测。此外,研究人员对BERT进行了广泛的研究,并引入了许多增强变体,如RoBERTa[91]和ALBERT[92]。

GPT系列模型:GPT系列是OpenAI开发的基于Transformer的预训练语言模型集 合,主要包括GPT 3.0[33]、GPT 3.5(ChatGPT)[35]和最新的GPT-4[37]。图4展示了GPT 3.5的三个训练步骤及其详细信息。GPT 3.5展示出了强大的自然语言理解能力,而最新的GPT-4集成了图像理解能力,具备高度智能的多模态信息处理能力。

图4 ChatGPT的训练算法流程图,其核心是基于人类反馈的强化学习(图像来自[35])

ERNIE系列模型:ERNIE系列是百度基于Transformer架构开发的预训练语言模型。该系列包括ERNIE 1.0[93]、ERNIE 2.0[94]和ERNIE 3.0[95]等。这些模型遵循大规模预训练语言模型的一般步骤,并结合了新的预训练方法、知识图谱和知识蒸馏技术来提高模型性能。

此外,许多公司和研究机构也开发了大量高质量的LSLMs。例如,Meta公司最近发布了LLaMA模型[96],该模型拥有高达650亿的参数量。同样,华为提出了万亿参数语言模型[97],在各种中文NLP任务中表现出色。目前,LSLMs正在不断改进和优化,详细综述和分析可参考相关综述论文[98, 99]。

4.2 CV中的大模型

在本节中,将综述边缘计算在机器信号采集和无线传输中的方法。随着低功耗芯片和高能量密度电池的快速发展,越来越多的机器使用IoT节点进行状态监测[58],[59]。IoT节点可以分布式安装,方便更换或调整,无需复杂的电源和信号电缆布线。

受自然语言处理领域中LSLMs取得巨大成功的启发,研究人员探索了LSF-Models在计算机视觉领域的应用[39, 100, 101]。同样,视觉大模型涉及在大规模图像数据集上进行表征学习,以实现跨域和高级语义理解,同时具备多任务处理能力。

2023年,Meta AI发布了首个大规模通用视觉图像分割模型——SAM[39,100]。他们还发布了最大的图像分割数据集,其中包含1100万张图像和10亿个掩码。图5展示了SAM的算法流程图。SAM作为一个单一模型,在交互式和自动分割方面表现出色,尤为突出的是它对图像数据中的一般概念有深刻的理解,能够为任何图像或视频中的任何对象生成掩码,即便这些对象在训练期间未曾出现过。这种零样本泛化能力,使得无需为微调模型而进行特定领域的数据的收集。

图5 SAM的算法流程图(来自文献[39, 100]),可以根据输入提示输出分割结果

对比语言-图像预训练(Contrastive Language-Image Pretraining, CLIP)[102]是OpenAI开发的一种多模态预训练模型。CLIP 通过对比学习,将匹配的图像和文本(正例)与不匹配的图像和文本(负例)进行比较,从而学习视觉和语言的联合表示。该模型在从互联网上收集的4亿张图像和文本数据集上进行训练,并且能够对未见过的数据进行零样本泛化,实现准确的图像和文本的匹配。

DALL⋅E[101]是OpenAI提出的基于Transformer和生成对抗网络(Generative Adversarial Network, GAN)的图像生成模型。DALL⋅E模型的核心是双流Transformer架构,其中一个流用于处理文本输入,另一个流用于处理图像生成。它能够自动理解人类自然语言描述的对象、场景和情况,并生成高质量的图像。

目前,这种范式的主流模型包括ViT-BERT[103]、BLIP[104]等。这些模型大多基于Transformer架构设计,通过预训练学习获得视觉和语言的交叉表示,并在各种任务中进行微调。它们在视觉和语言的各种应用中表现良好,为正确的视觉和语言理解奠定了坚实的基础。

4.3 研究趋势与未来方向

当前大规模模型的研究趋势主要朝着多模态、超大模型和特定领域应用方向发展。多模态模型旨在将不同的数据类型,如文本、图像、音频等,整合到一个统一的模型中,以实现跨模态的理解、生成和处理。例如,类似于CLIP模型的视觉-语言表征学习模型正在迅速发展,旨在实现图像和自然语言之间的跨模态理解和交互。此类模型极大地扩展了大规模模型的应用范围和潜力。

此外,研究人员不断突破模型规模的界限,包括构建更大的神经网络和更多的参数,以提高性能。为了解决超大模型的计算和存储需求,研究人员还致力于开发模型压缩和加速技术,以便在资源受限的环境中运行大规模模型。

最后,大规模模型在特定领域应用中具有巨大潜力,这已成为大规模模型研究的一个新热点。目前,大规模模型已在医疗保健、自动驾驶和智能交通等领域成功应用,并有望在各个行业释放出卓越的应用潜力。

5 PHM领域的大模型

5.1 用于PHM的大规模数据集

5.1.1 研究现状

与NLP和CV领域不同,PHM中的数据通常是由各种传感器收集的高频或低频时序数据,如振动信号、声音信号、电流和电压、温度、压力等。此外,一些应用尝试使用视频和图像数据来实现设备健康监测,如轨道缺陷监测[106]、缺陷产品识别[107]和设备裂纹监测[108]。目前,PHM社区已经开源了数十个不同规模和领域的数据集,如轴承故障数据集[109]、飞机发动机退化数据集[110]、三相电机故障数据集[111]、风力涡轮机监测数据集[112]等。然而,这些数据集的规模非常小,难以满足LSF-Models训练和优化的需求。因此,构建PHM大规模数据集是实现LSF-Models的第一步。

物联网技术[113]的出现使得大量传感器被安装在当代工业生产设备和各种复杂机械设备上,以便实时监测系统的各种物理量,及时发现异常情况。因此,大多数大型企业已经收集了大量的工业数据并建立了相应的数据中心。例如,中国的城市轨道列车拥有数十年的运营经验和积累的实际运行数据,生成了海量且全面的数据集[114]。现在,一辆列车可以实时监测和记录数百个与其子系统、组件和外部环境相关的变量,如轴承油温、变速箱噪音以及各种系统的电流和电压。同样,轨道检测车可以在较长距离内获取诸如轨距、水平和高度等密集参数。这些大规模数据集为构建LSF-Models提供了有价值的信息,包括列车子系统和组件的实时状态、退化过程和相互依存关系。

尽管这些工业数据在LSF-Models以解决各种PHM任务方面具有巨大潜力,但仍需要进一步探索。工业数据可能包括各种传感器数据,如信号、图像、视频以及大量文本信息,如维护工单和报告。因此,构建能够有效利用这些多传感器数据的LSF-Models带来了新的挑战。此外,单个数据中心的数据规模可能对于构建LSF-Models来说是有限的。例如,GPT3.0[33]的训练数据超过4100亿个标记,而GPT3.5[35]的训练数据可能远远超过GPT3.0。为了解决这个问题,跨中心或跨区域的联合深度模型训练和优化是一种可行的解决方案。然而,这些工业数据通常涉及商业机密,因此政府和企业已经制定了严格的数据保护 法规,这极大地限制了工业数据的共享和使用。

此外,必须强调工业数据的质量。由于工业硬件的固有局限性和苛刻的运行条件,收集的数据往往无法满足深度模型有效训练和优化的要求。工业数据通常存在许多缺陷,如缺失值、异常值和意外的信号波动。为了解决这一挑战,Zou等[115]提出利用KNN和局部异常因子方法来填补间隙和识别电力变压器数据中的异常值。同样,Zeng等[116]通过应用异常检测技术和插补缺失值来增强对高炉炼铁过程的识别。因此,对工业数据质量进行全面调查并采用实用方法来提高其整体质量至关重要。

5.1.2 解决方案

虽然LSF-Models在自然语言处理和计算机视觉领域取得了有前景的结果,但PHM数据与前两者有很大不同。因此,有必要根据PHM领域的独特数据特征优化和改进LSF-Models的关键组成部分,以在该领域实现良好的性能。这需要探索适合PHM的新型特征提取模型、SSL算法和MMF算法。此外,在工业领域,学术界已经建立了前沿的算法设计和数据分析能力,而工业界积累了大规模的工业监测数据。因此,建立校企联合研究中心以充分发挥各自的优势,将有效应对现有挑战,并显著促进PHM中LSF-Model的研究。

此外,LSF-Models的实施需要访问大规模数据。在利用这些数据的同时确保数据隐私保护是另一个值得关注的关键问题。与NLP和CV领域不同,在这些领域相关数据可以从互联网上大规模获取,而PHM数据集掌握在设备运营商手中,它们通常很珍贵并且可能包含商业机密。此外,随着对数据隐私和安全的关注度不断提高,监管机构已经出台了新的法律来规范数据的管理和使用[117]。因此,有必要开发符合严格隐私保护 法规的解决方案,并解决数据碎片化和隔离的挑战。联邦学习[118, 119]是一种具有隐私保护和安全加密的分布式机器学习框架,是一种可能的解决方案。它允许分散的参与者在不向其他参与者披露私有数据的情况下合作进行机器学习模型训练。目前,已经在PHM中提出了基于联邦学习的数据隐私保护解决方案[120, 121]。图6展示了基于联邦学习的多车辆和多中心数据隐私安全保护架构。然而,现有的大多数联邦学习算法尚未在实际的工业大规模数据分析中部署。因此,促进大规模工业数据分析和LSF-Models的建立需要学术界和工业界的共同努力。

图6 面向多车多中心数据隐私安全保护的联邦学习框架流程图

5.2 用于PHM的Transformer

5.2.1 研究现状

Transformer[46]是一种专门用于对长距离特征相关性进行建模的深度学习模型,它能够对信号中任意两个位置之间的相关性进行建模,而不受特征之间实际物理距离的限制。其高效的长短期依赖建模能力使其非常适合分析和处理PHM中的各种传感器数据[21]。因此,Transformer在PHM中得到了广泛应用,并取得了令人瞩目的性能结果。例如,Jin等[122]提出了一种基于时间序列的Transformer模型,与传统的CNN和RNN相比,该模型具有更优的故障识别能力。Wang等[21]提出了一种基于Transformer的高速列车车轮磨损预测模型,该模型结合了Transformer和CNN的优势,能够有效地编码全局和局部信息。Fang等[123]对Transformer进行了优化,并提出了一种基于Transformer的轻量级故障诊断框架,该框架在降低计算复杂度的同时实现了高效准确的故障诊断。

尽管在PHM中取得了显著成功,但Transformer在处理工业时间序列数据时的长距离依赖建模仍然不足,并且存在一些需要解决的局限性。首先,Transformer模型主要是为处理静态输入数据(如文本)而设计的,虽然它可以通过位置编码纳入时间信息,但它没有直接考虑时间信息[124]。因此,在处理工业时间序列数据时,Transformer难以充分学习数据的连续时间关系。其次,Transformer模型可能对含有噪声的工业数据表现不佳。在实际的工业生产过程中,含有噪声的工业数据很常见,而Transformer在处理这类数据时可能不够鲁棒。第三,如前所述,工业数据通常包含多种类型的传感器数据和大量文本信息,这对Transformer架构的设计提出了新的挑战。Transformer通常不能同时处理大量传感器数据。

5.2.2 解决方案

由于自注意力机制在考虑序列中位置之间的关系时存在限制,难以捕捉时间轴上的相关时间关系。为了解决这个问题,可以采取以下几种方法。首先,可以将时间编码机制集成到Transformer模型中,以促进对时间关系的直接学习。其次,可以探索有效的时间注意力机制,以在Transformer架构内捕获数据之间的时间依赖关系。最后,可以探索基于Transformer的时间序列模型,同时考虑传感器数据的特点。这些模型需要专门设计用于处理时间序列数据,整合全局时间序列信息,并改进时间相关性的建模。工业领域收集的数据通常包含复杂的噪声。这与NLP和CV领域不同,在这些领域数据通常是干净的。因此,大多数现有的DL模型在处理时间序列信号中的噪声或无关信息干扰方面能力不足。在传统的信号分析中,已经提出了各种方法来去除信号噪声并提取有价值的信息,这些方法包括频域滤波[125, 126]、快速傅里叶变换(Fast Fourier Transform, FFT)[127]、小波变换[10]等。因此,将Transformer与信号分析技术深度融合可能是一种有前途的解决方案。例如,Wang等[128]通过将小波变换与DL模型融合,在噪声环境中取得了良好的性能,其提出的多层小波模型如图7所示。然而,如何赋予Transformer更先进的信号分析能力仍有待进一步研究。图7 融合了小波和CNN的多层小波模型的架构(图像来自[128])

最后,为了同时处理多传感器数据和工业文本数据,必须重新设计Transformer架构并创建多模态Transformer[129, 130]。有几种可行的解决方案,包括基于Transformer的多模态嵌入、基于Transformer的跨模态预训练和基于Transformer的多模态注意力。多模态嵌入将各种传感器数据编码并嵌入到Transformer架构中,以同时表示多传感器数据。跨模态预训练利用各种传感器数据对Transformer进行预训练,以从不同数据类型中学习有价值的信息,然后将其应用于下游的多传感器数据处理。多模态注意力是一种常见的解决方案,通过利用注意力权重实现多传感器信息的自适应融合。 5.3 用于PHM的自监督学习

5.3.1 研究现状

如前所述,在工业生产和设备运行过程中会收集大量的传感器监测数据。然而,学术界和工业界都在努力充分利用这些大量的运行数据来构建PHM模型。主要挑战包括缺乏标记数据、存在噪声以及数据量巨大。因此,现有深度模型难以从这些数据中有效提取有用信息。SSL[42, 72]能够从大量未标记数据中自动学习有价值的特征表示,已成为构建PHM基础模型的核心算法。目前,SSL已经在PHM中得到了研究和应用[131-133],并展示出了令人印象深刻的性能。例如,Zhang等[134]开发了一种结合先验知识的自监督算法,在小标记数据集上表现出良好的故障识别能力。Wang等[135]提出了一种用于自监督表征训练的新型前置任务,能够有效地从未标记信号中提取有价值的信息。同时,Ding等[131]开发了一种基于对比学习的预训练算法,在识别轴承早期故障方面显示出了潜力。然而,它需要设计有效的前置任务来学习有用的特征表示。当前的前置任务可能无法充分捕捉与故障和健康相关的信息,特别是在复杂的工业系统中。此外,SSL模型可能对噪声敏感,在数据质量较差的情况下,可能会影响学习到的特征表示,从而降低故障诊断和健康管理的性能。另外,现有的SSL算法在处理包含多种传感器模态的现实工业数据方面存在困难。因此,开发能够处理此类工业数据的有效SSL算法是一个关键的研究重点。5.3.2 解决方案

研究LSF-Models的根本目的是实现小/零样本泛化。因此,在设计模型和算法时需要解决的首要问题是:什么样的模型和算法能够实现零样本泛化[39]。类似于自编码器的架构[27],特别是与信号重建、信号补全、信号去噪等相关的架构,是一种有效的解决方案。然而,它们的特征表示过程与健康信息缺乏直接关联。因此,在开发前置任务时,必须确保与设备健康具有最大相关性。

在PHM中,频域是比时域更能有效反映设备健康状态的方法。因此,在构建SSL前置任务时,必须全面考虑信号频域信息。有几种潜在的解决方案。1)开发一种深度频域空间学习模型,如基于小波的CNN[128, 136, 137],它能够直接学习频率特征并捕获数据中的频率信息。2)构建依赖于信号频域数据的前置任务,如重构频域信息。3)创建基于信号时频一致性[138]的对比学习算法,以便对时间序列数据进行有效的自监督训练。此外,对于多传感器信号,可以利用多传感器数据的相关性来构建前置任务。例如,一种方法是利用一部分传感器数据来预测其他传感器数据的值。这有助于模型学习多个传感器之间的直接相互依赖关系。最后,不同的SSL算法可以表示数据的不同特征信息。组合多种SSL算法可以帮助模型学习更多样化的特征表示,提高下游任务的性能。因此,使用各种算法对模型进行全面预训练是一种很好的解决方案。

5.4 用于PHM的多模态融合

5.4.1 研究现状

工业领域的数据可能包含多种传感器数据类型(如信号、图像、视频等)和大量文本信息(如维护工单、维护报告等)。因此,与NLP和CV相比,PHM领域更强调多传感器数据的信息融合,以全面了解设备健康状态。目前,已经有一些工作探索了多传感器信息的融合[139-141]。例如,Guan等[139]提出了一种基于峰度加权算法和金字塔原理的多传感器多尺度融合模型,在轴承健康识别方面表现出很强的性能。Long等[142]利用希尔伯特变换和FFT从多传感器信号中提取有价值的频率信息,然后开发了一种基于注意力的模型用于故障识别。Kumar等[141]同时考虑振动和声音信号,利用小波变换作为特征提取器,随后应用机器学习方法进行故障诊断。

然而,大多数现有的数据集仅包含一到三个传感器的数据,远远无法满足实际工业应用的需求。此外,随着传感器数量的增加,不同传感器产生的数据可能具有不同的分布、尺度和信噪比。适当的预处理方法和融合策略对于提升PHM模型的性能至关重要。在工业领域,MMF算法必须考虑各种工业传感器信息(如信号、图像、文本等)的融合。然而,现有的研究对于这一挑战缺乏足够的解决方案和优化策略。

5.4.2 解决方案

在PHM中实现有效的多传感器数据融合需要在数据融合、特征融合和模型融合方面做出全面努力。以下解决方案可以增强模型的多传感器融合能力:

(1)对于数据级融合,可以使用归一化、对齐、变换和降维等方法来整合不同模态的数据。对齐方法将不同模态的数据对齐到一个共同的坐标系中。变换和降维可以用来去除冗余信息并将其映射到一个共享的特征空间。

(2)根据特定任务和数据特征构建适当的注意力机制,以实现高效的多传感器相关建模并融合来自传感器的有价值特征。这种机制使模型能够捕捉传感器之间的相关性并突出相关特征。

(3)优化模型的结构和参数,以更好地适应不同传感器数据的特征。此外,对于不同的传感器数据,可以构建不同的模型,然后使用MMF算法在这些模型之间建立连接,实现多传感器信息融合。

(4)探索基于知识图谱和图注意力模型组合的算法。知识图谱使用图结构对实体之间的关系和属性进行编码,以组合来自不同层次的信息。图注意力模型进一步对图结构进行编码,以提取高级融合特征。

最后,上述解决方案都是通用的,需要根据特定的数据和应用充分结合Transformer和SSL,以实现MMF的最佳性能。

校核:李正平、陈凯歌、赵栓栓、曹希铭、赵学功、白亮、任超、海洋、Tina、陈莹洁、王金、赵诚该文资料搜集自网络,仅用作学术分享,不做商业用途,若侵权,后台联系小编进行删除